Для чего в процессорах Apple нужны нейроядра Neural Engine. Третья сила магии iPhone

Начиная с iPhone X, ко всем своим чипам серии A Apple добавляет приставку Bionic. Природная натура этого слова подкрепляется особенным модулем внутри процессора, который называется Neural Engine.

Он состоит из вычислительных блоков, которые помогают iPhone решать задачи, связанные с контекстом.

Перед Neural Engine не стоит задача решить уравнение или отобразить изображение. Это гораздо более тонкая технология, без которой наши смартфоны оставались бы скучными и не умели узнавать нас в лицо.

Ниже расскажу, почему Apple хвалится развитием этого элемента в своих чипах с такой же частотой, как с CPU и GPU. Объясню, зачем именно нужен Neural Engine в том числе в MacBook. А ещё проследим, как нейроядра внутри iPhone стали третьей необходимой силой после вычисления и графики.

Как устроены чипы. CPU и GPU на ПК отдельно, у мобильных вместе

В большинстве ПК, особенно домашних, установлены два главных чипа: CPU и GPU. Они физически находятся в разных частях системного блока и в большинстве случаев созданы разными производителями.

CPU расшифровывается как Central Processing Unit и переводится «центральное вычислительное устройство».

Отвечает за сложные и параллельные вычисления инструкций. Без него компьютер не заработает.

GPU расшифровывается как Graphic Processing Unit и переводится «графическое вычислительное устройство».

Формирует и выводит на монитор визуальную информацию, красиво отображает вычисления процессора и его ОС (операционной системы).

Иногда GPU встраивают прямо в CPU, такой элемент слабее и чаще всего служит временной заменой, чтобы вы видели происходящие внутри компьютера размышления, пока ищете замену дискретной видеокарте. Такие поставляются отдельными модулями.

В компактных устройствах железо работает не только на выдачу мощного результата, но и на сохранение энергии. Важно, чтобы устройство не перегрелось из-за избытка тепла от большой вычислительной нагрузки.

Тут встроенная в CPU графика уже главная, дополнительные процессоры, как правило, либо обрезаны в мощности, либо полноценно работают только при подключении к сети. В смартфонах и планшетах дискретного модуля GPU в принципе не бывает.

Единственный управляющий чип становится чем-то больше обычного CPU. Он превращается в комплексную систему.

И Apple уже добилась в этом лидирующей позиции, поэтому стала интегрировать в процессоры новый тип вычислительных транзисторов.

Есть CPU, есть GPU, а есть Neural Engine

История началась с процессоров для iPhone, в которые постепенно интегрировались новые элементы. Например, Neural Engine. Он ускоряет умные фишки камеры, помогает лучше анализировать голос для Siri и быстрее распознавать людей на ваших фотографиях.

Чуть позже тем же подходом Apple сделала комплексный чип M1 для своих Mac. Внутри него этих ядер ещё больше, и они ежедневно помогают решать те же задачи, что и в iPhone.

В потребительских устройствах для этих целей отдельный чип не ставили, но за ним постепенно закрепляется похожее название.

NPU расшифровывается как Neural Processing Unit и пока никак общепринято не переводится на русский.

Термин постепенно входит в употребление, но каждый производитель называет его по-своему. Будем опираться на формировку Apple, которая звучит как Neural Engine или «Нейронный процессор».

Должно соблюдаться условие: система, которую будут запускать на таком типе процессора, должна быть сначала натренирована на других примерах.

Первый Neural Engine использовали исключительно для Face ID

Apple полностью контролирует производство своих процессоров начиная с iPhone 4 и чипа внутри него A4, которые вышли в 2010 году.

Компания среди первых начала внедрять новые технологии в чипы на мобильных устройствах. Например, переход на 64-битную разрядную систему, интеграцию сопроцессора движения и фотографии, использование минимальных техпроцессов (7 нм, 5 нм).

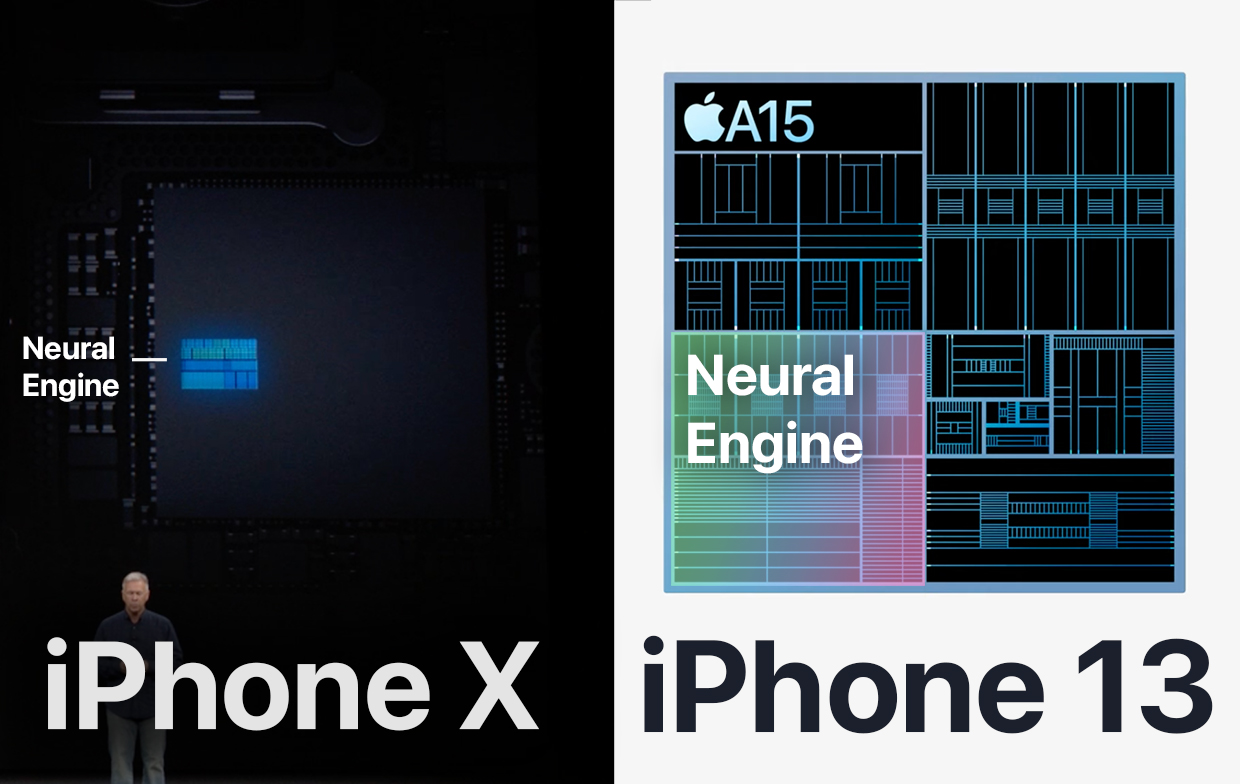

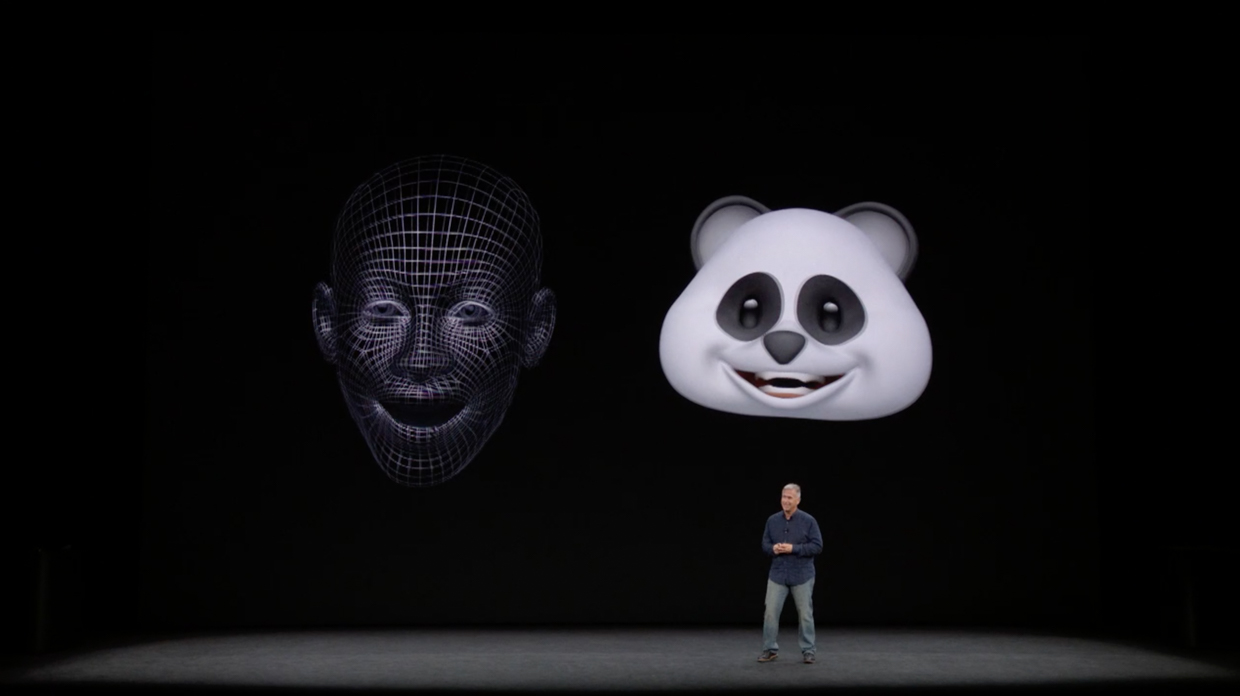

Ключевым стал 2017 год, когда вышел iPhone X. На его презентации впервые пошла речь о небольшом нейросетевом модуле внутри чипа A11, который Apple впервые и до сих пор называет с приставкой Bionic.

Тогда этому маленькому блоку внутри чипа уделили каплю внимания, чтобы рассказать, как он юрко отличает настоящее лицо от искусственной копии в виде театральной маски. Мы узнали о Neural Engine только то, что он способен обучаться по внешнему виду пользователя, и на этом всё.

С каждым новым поколением NPU значительно развивали и обучали новым возможностям.

В 2021 году он помогает искать определённых людей и создавать воспоминания в приложении Фото, анализировать 40 мимических лиц в реальном времени и создавать Киноэффект в iPhone 13.

Эволюция оказалась впечатляющей.

Как развивался Neural Engine в iPhone

Каждая презентация Apple не обходится без упоминания сопроцессора и без указания, насколько выросла его производительность.

Ниже будет полный список iPhone начиная с 2017 года, с описанием возможностей, которые добавляла компания вместе с улучшением Neural Engine и его ядер.

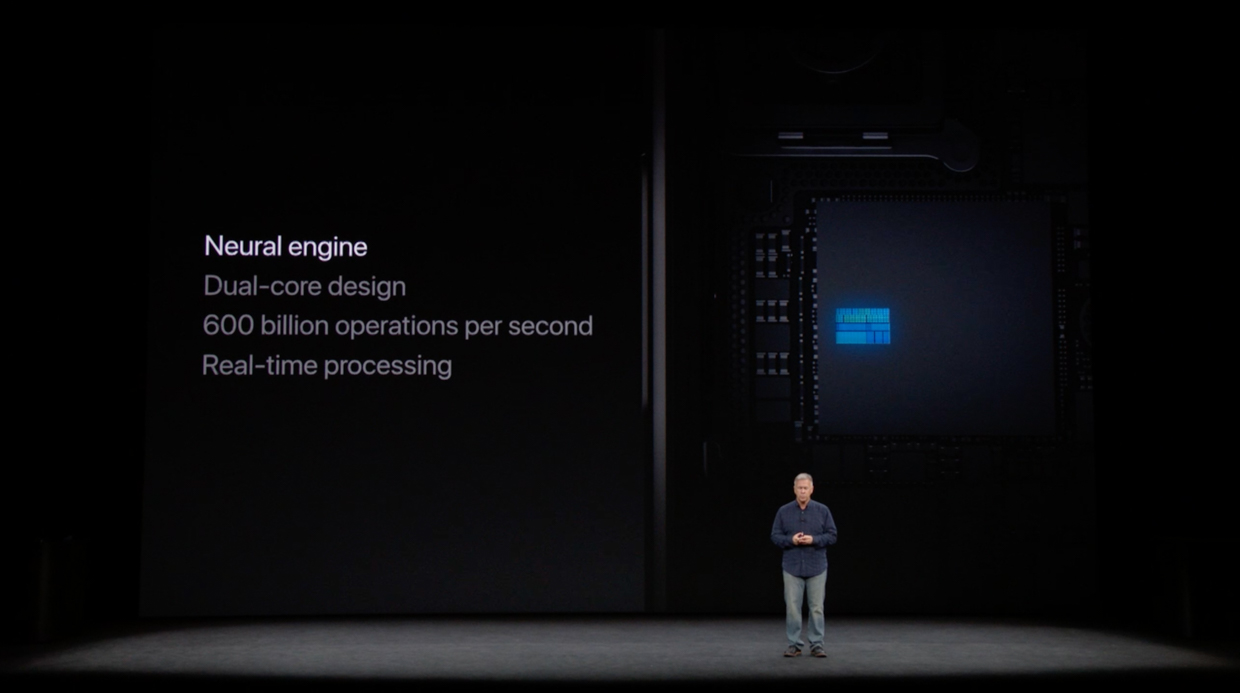

iPhone X

В чипе A11 внутри iPhone X технология появилась первые.

Два ядра, которые служили исключительно для того, чтобы корректно распознавать лица.

Производительность: 600 миллиардов операций в секунду.

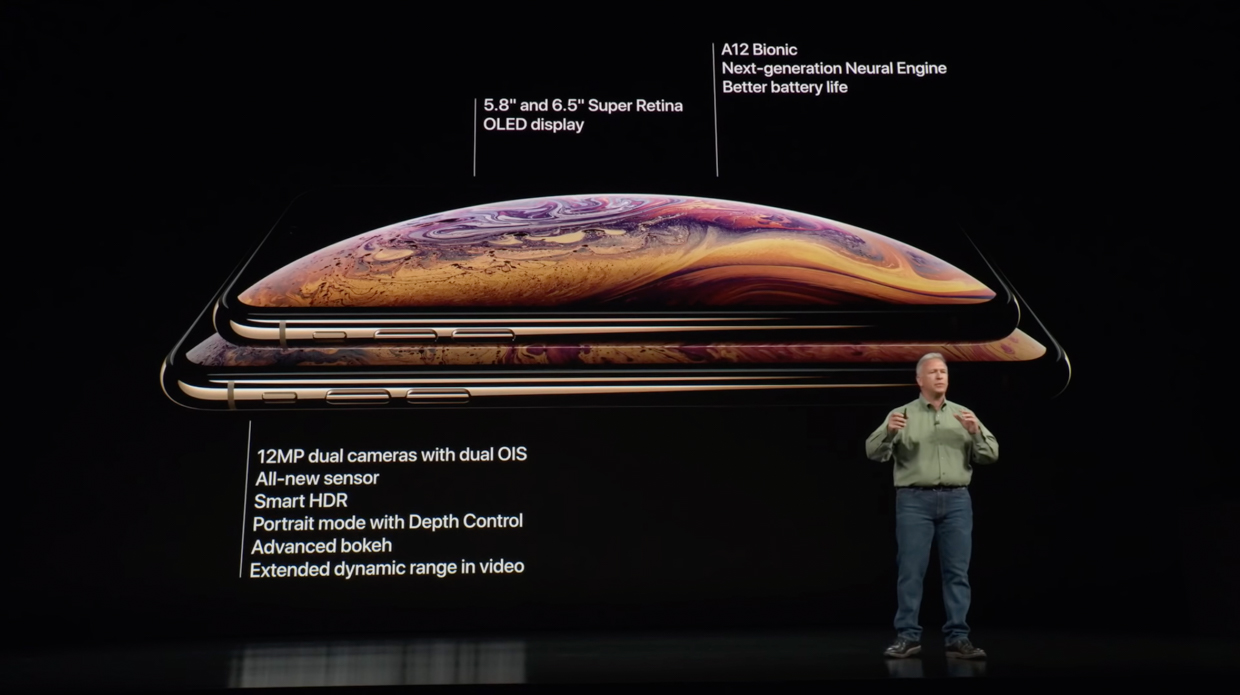

iPhone XS и iPhone XR

В A12 внутри iPhone XS и iPhone XR поставили 8 нейроядер, к которым добавили машинное обучение в других приложениях кроме Face ID и «умную вычислительную систему».

Эта система распознаёт тип задачи, поступающей в процессор, и решает, на каких блоках её обрабатывать: в Neural Engine, CPU или GPU.

Машинное обучение улучшило:

• Предложения слов в клавиатуре

• Подборку фотографий в Воспоминаниях

• Вывод полезных мест в Картах

• Адаптацию экрана True Tone

• Поиск снимков в Фото.

Это было нужно для портретного режима с одной камерой на iPhone XR и для AR-эффектов камеры. Например, чтобы накладывать сценический свет или отслеживать движение 50-ти мышц лица во время звонка по Face Time.

Именно благодаря обучению «на ходу» режим портрета из iOS 15 в Face Time доступен на смартфонах с процессором A12 Bionic и новее.

Производительность: 5 триллионов операций в секунду.

iPhone 11 и iPhone 11 Pro

В A13 внутри iPhone 11 установлен Neural Engine снова из 8 ядер.

Тогда блоку повысили мощность на 20% и снизили потребление на 15% за счёт выборочной подачи энергии на разные области A13.

Вместе с машинным обучением NPU улучшил распознавание речи и стал быстрее справляться с трекингом лицевой мимики в реальном времени.

В этот раз в CPU добавили блоки для ускорения машинного обучения, которые стали в 8 раз быстрее проводить матричные вычисления. Вероятно, именно они дали ускорение нейроядрам.

Производительность: 6 триллионов операций в секунду.

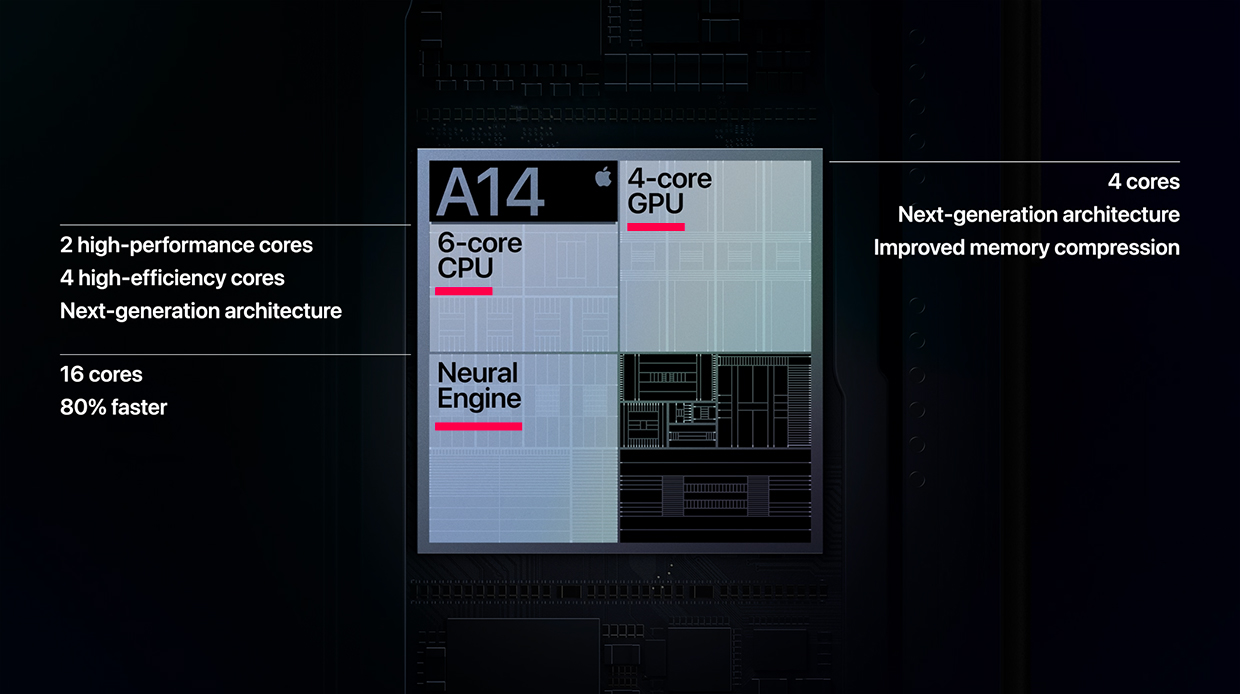

iPhone 12 и iPhone 12 Pro

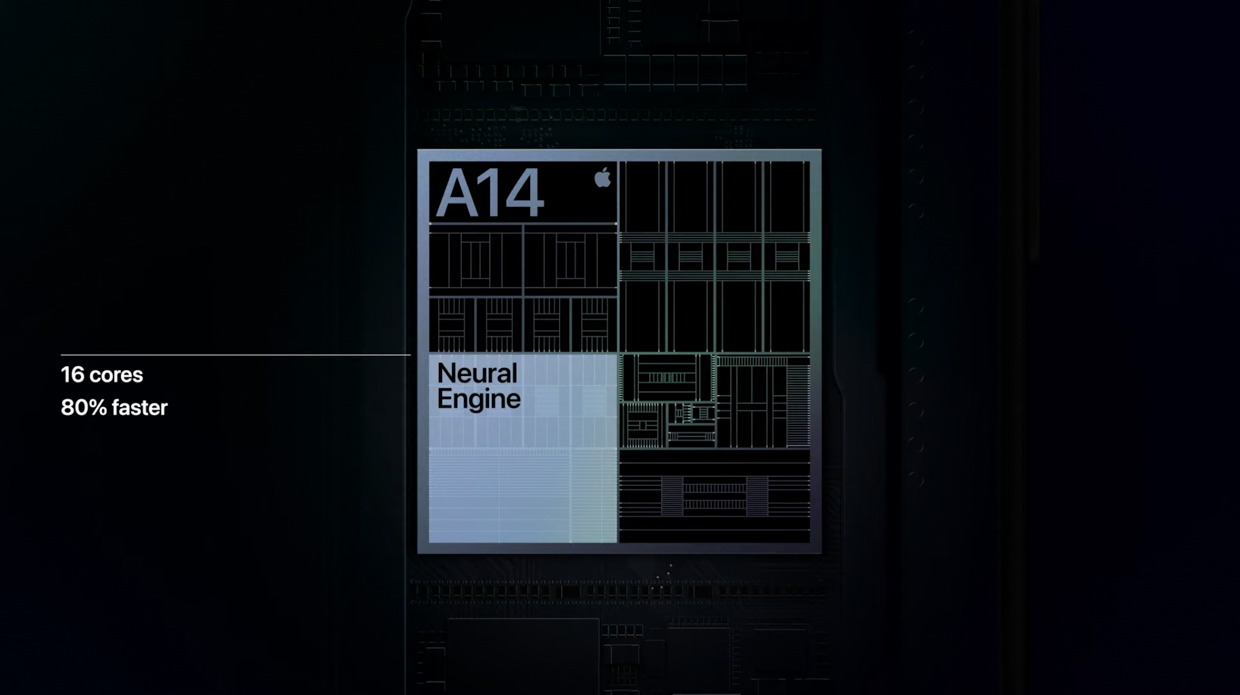

В A14 из iPhone 12 Neural Engine стал в два раза больше и состоял из 16 ядер.

NPU стал на 80% быстрее того, который был установлен в A13.

Эти улучшения помогли внедрить Deep Fusion во все камеры iPhone, включая фронтальную и сверхширокоугольную. Последняя, несмотря на то, что физически была идентична прошлому поколению, стала снимать более чёткие фотографии.

Этот же NPU установлен во все чипы серии M1 от Apple для Mac.

Производительность: 11 триллионов операций в секунду.

iPhone 13 и iPhone 13 Pro

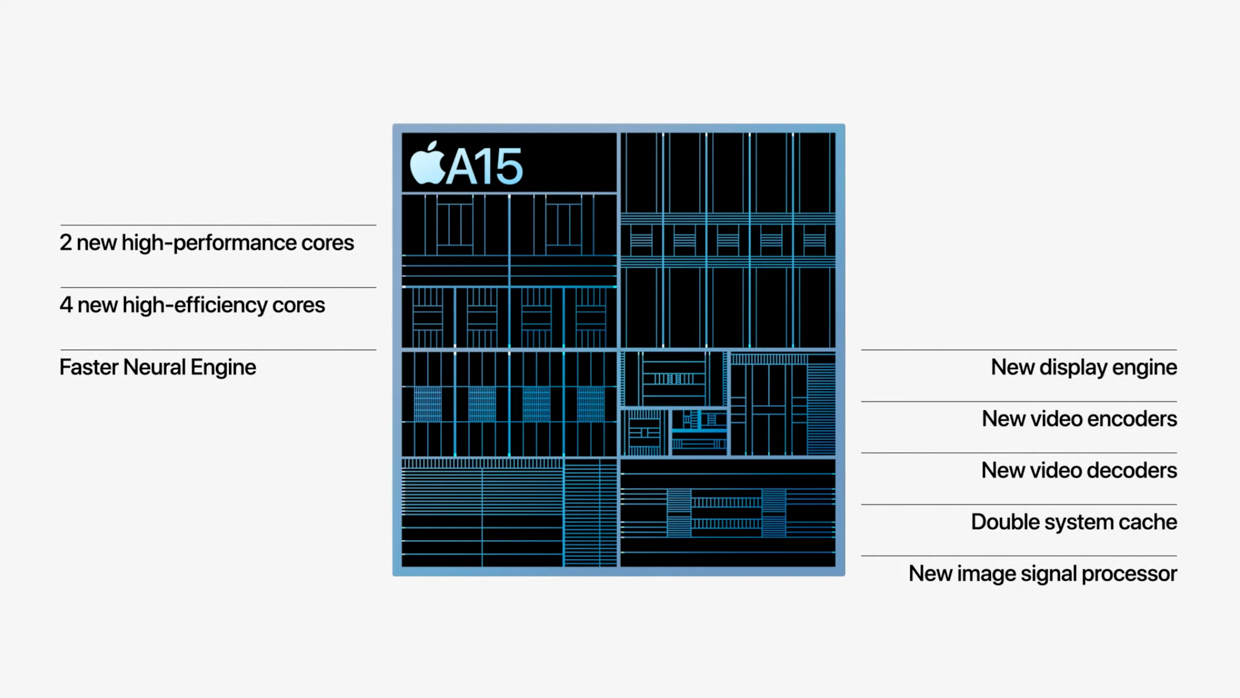

В A15 из iPhone 13 Neural Engine остался с теми же 16 ядрами. Но они стали заметно мощнее. Даже в новых M1 Pro и M1 Max такого нет.

На этой презентации Apple напомнила, что установленные в Neural Engine элементы для машинного обучения работают эффективно за счёт блоков их ускорения в разделе CPU.

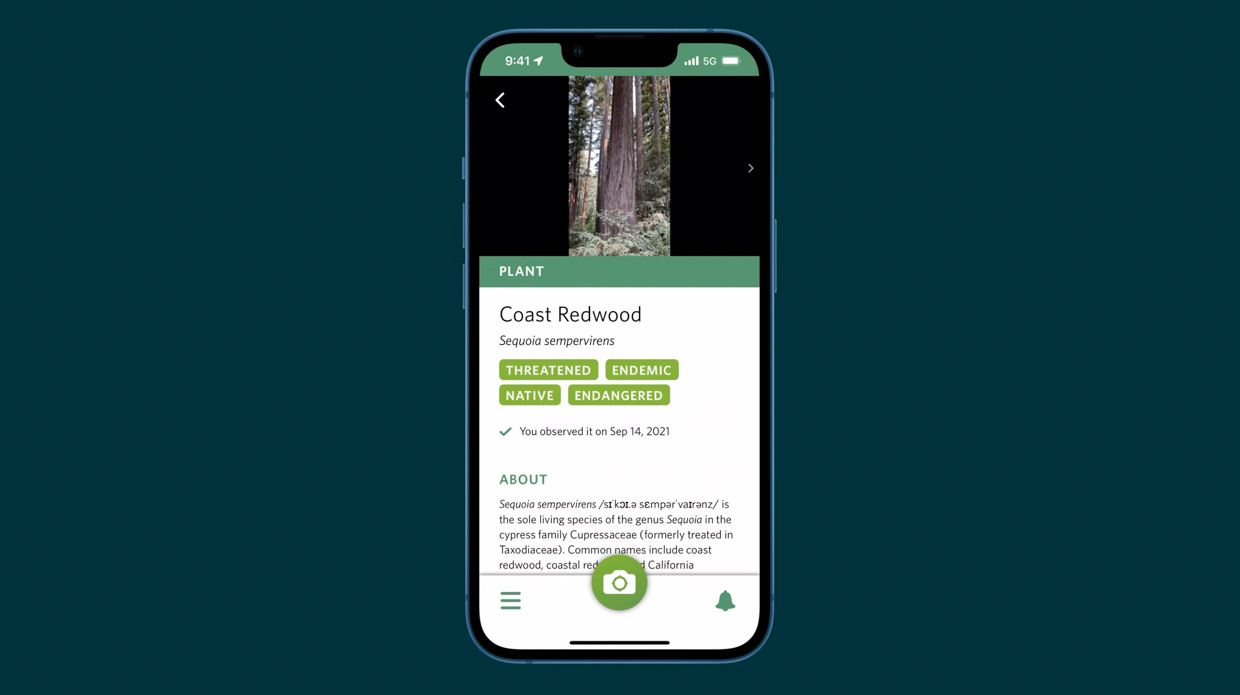

На данный момент это самый мощный NPU среди продуктов Apple. Главной его возможностью стала запись видео с глубоким размытием. Режим в приложении Камера в любом из iPhone 13 называется Киноэффект.

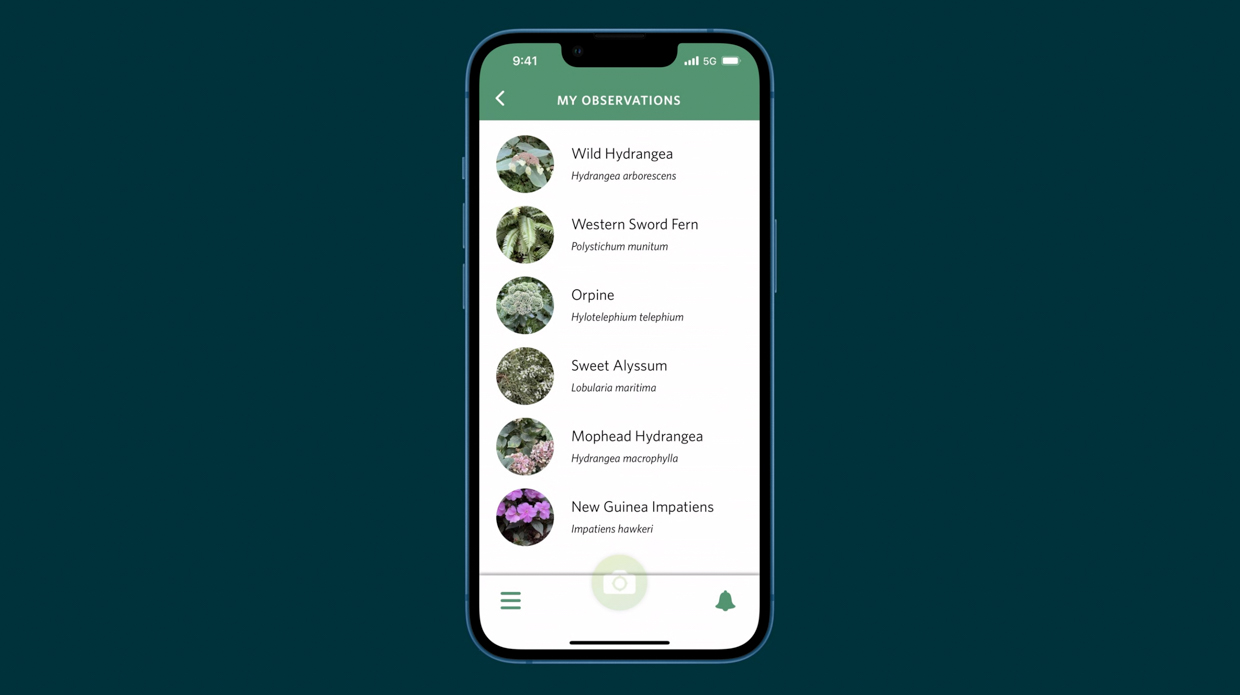

Ещё он помогает Siri распознавать диктовку и корректировать навигатор внутри Apple Maps, делать трекинг предметов в реальном времени, распознавать виды растений и ускорять перевод текста с фотографии в письменный.

Производительность: 15,8 триллионов операций в секунду.

В чём ещё помогает Neural Engine в смартфонах

Многие считают Siri отстающей в развитии по сравнению с другими ассистентами, но на самом деле за этой технологией стоят сложные процессы.

Раньше, когда вы задавали вопрос «Скажи курс доллара к рублю», смартфон записывал данные и отправлял их на сервер с сопроводительными данными вроде обладателя голоса, местоположения, времени суток, чтобы было проще сформулировать ответ. Позже ответ обрабатывался и отправлялся обратно.

Сейчас нейросетевой чип в смартфоне берёт обработку натуральной голосовой модели на себя. Он в реальном времени превращает речь в запрос сам, и в некоторых ситуациях берёт на себя его полную обработку. Он сам понимает, что пользователь хочет узнать и сам же формирует сценарий, по которому будет отвечать.

Например, если вы попросите смартфон сделать сложные расчёты, он справится с ними намного быстрее, чем раньше, потому что сделает это без отправки на сервера. А расчёт начнёт до того, как вы закончите говорить.

Зачем Neural Engine в Mac

Огромный кусок главных функций M1 занимает Neural Engine в правом верхнем углу

Apple постепенно переводит компьютеры Mac на свои процессоры. Год назад, в ноябре 2020-го представили чип M1, в октябре 2021-го к ним добавились M1 Pro и M1 Max.

Несмотря на разницу в производительности CPU и GPU, в каждом из них установлен один и тот же NPU из 16 ядер с мощностью 11 триллионов операций в секунду. То есть он дублирует таковой из A14 внутри iPhone 12.

Выделенные нейроядра в Mac ускоряют процессы в работе профессионалов, завязанные на машинном обучении.

Фотографы могут применить их в Pixelmator Pro, который увеличивает разрешение изображения с помощью процессов машинного обучения, которые активирует Neural Engine.

Видеографы могут использовать функцию умного отслеживания объектов в Final Cut Pro X, чтобы быстрее обрезать видео.

Для разработчиков, учёных и инженеров в их специализированных расчётах и преобразованиях данных, постановки виртуальных экспериментов он тоже будет полезен.

Например, на базе машинного обучения работает платформа TensorFlow. Она помогает внедрять в приложения такие технологии, как распознавание жестов, понимание контекста в естественных вопросах, перенос стиля одного изображения на другое. Чем быстрее будет железо, сделанное для него, тем лучше заработают эти функции.

Часть iPhone, которая делает его iPhone

Apple не устаёт повторять, что её сильная сторона кроется в трепетной связке ПО и железа.

Компания внедряет в свои смартфоны всё больше функций, которые полагаются на заточенные под них ядра. Среди них процессор обработки фото, управления дисплеем, портами и Neural Engine.

«Нейронный движок» помогает смартфону на лету понимать речь, подбирать трогательные Фото в виджете на рабочем столе и выдавать релевантные Воспоминания, отслеживать объекты в кадре Smart HDR, режима портрета и Киноэффекта.

Neural Engine формирует быструю и корректную выдачу данных в Spotlight, распознаёт текст из Камеры, может различать разные виде растений и породы собак.

И в целом он превращает смартфон в устройство, которое с каждым поколением всё лучше распознаёт контекст запроса без подключения к интернету.

Это одна из самых сильных вычислительных сторон iPhone помимо CPU и GPU. И она развивается сумасшедшими темпами из года в год.

Сложно предсказать, на что нейроядра будут способны через 10 лет. Но пока они выполняют свою работу бесшовно и незаметно для пользователя, Apple всё ещё может называть эту технологию магией.

Новая технология Neural Engine и Apple GPU — Apple A11 Bionic

Было опубликовано 25 июля 2019 года

Обновлено 5 ноября 2020 года

Apple A11 Bionic – ARM-система на кристалле (SoC), разработан Apple и изготовлен TSMC. Cочетает в себе процессоры Monsoon и Mistral с графическим процессором Apple GPU.

Впервые появился в iPhone 8, iPhone 8 Plus и iPhone X.

Согласно Apple, Apple A11 Bionic имеет два высокопроизводительных ядра, которые на 25% быстрее, чем в Apple A10 Fusion, и четыре высокопроизводительных ядра, которые на 70% быстрее, чем энергоэффективные ядра в A10.

О процессоре

A11 оснащен разработанным Apple 6-ти ядерным процессором с двумя высокопроизводительными ядрами на частоте 2,39 ГГц, называемыми Monsoon, и четырьмя энергоэффективными ядрами, называемыми Mistral. Ядра Mistral основаны на ядрах Apple Swift от Apple A6. A11 использует новый контроллер производительности второго поколения, который позволяет A11 использовать все шесть ядер одновременно, в отличие от своего предшественника A10.

Чип также интегрирует разработанный Apple трехъядерный графический процессор (GPU) с 30% более высокой графической производительностью, чем A10. В A11 встроен сопроцессор движения M11. Apple A11 Bionic включает в себя новый процессор обработки изображений, который поддерживает вычислительные функции фотографии, такие как оценка освещения, широкий захват цвета и расширенная обработка пикселей.

Рейтинг Antutu

Apple A11 Bionic в рейтинге Antutu набирает около 290.000 баллов. Для сравнения A10 Fusion набирает примерно в среднем 225.000 условных единиц.

Neural Engine

A11 включает в себя выделенное нейронное сетевое оборудование, которое Apple называет «Neural Engine«.

Это оборудование нейронной сети может выполнять до 600 миллиардов операций в секунду и используется для Face ID, Animoji и других задач машинного обучения. Neural Engine позволяет Apple реализовать нейронную сеть и машинное обучение более энергоэффективным способом, чем использование основного процессора или графического процессора.

Однако сторонние приложения не могут использовать нейронный движок данного поколения, что приводит к аналогичной производительности нейронной сети для старых iPhone.

Поддержка

Начало поддержки iOS — iOS 11. Обновления программного обеспечения для систем, использующих этот чип продолжается до сих пор. Производство продолжалось с 2017 года по 2020 год.

Технические характеристики

Базовая частота – 2x 2,39 ГГц ( Monsoon ) + 4x 1,42 ГГц ( Mistral )

Количество ядер – 6

Модель ускорителя – Apple GPU

Количество ядер – 3

Тип оперативной памяти – LP-DDR4X 2133 МГц

Количество оперативной памяти – 3 ГБ

Прочее

Технологический процесс – 10 нм

Количество транзисторов – 4,3 млрд

Набор инструкций – ARMv8.2-A

Площадь кристалла – 87.66 мм^2

Версия Bluetooth – 5.0

Версия Wi-Fi – 5

Поддержка 5G – нет

О технологии Neural Engine в процессорах Apple A-серии

Было опубликовано 20 января 2020 года

Обновлено 2 декабря 2020 года

Приставка «Bionic» к названию процессоров появилось не просто так. На кристалле стал размещаться еще один процессор, который маркетинг Apple назвала «нейронным движком» (Neural Engine).

Он основан на нейронных сетях, которым еще лет 20 назад пророчили лидирующую роль в вычислительной технике.

Позже на помощь Neural Engine пришли блоки AMX, но об этом ниже.

Для чего нужен Neural Engine

Отдельный процессор NPU значительно ускоряет работу таких ресурсоёмких задач как: дополненная реальность (поддерживаемая фреймворком Apple ARKit), машинное обучение и построение нейронных сетей (поддерживаемые фреймворком Apple Core ML).

Технология позволяет Apple реализовать нейронную сеть и машинное обучение более энергоэффективным способом, чем использование основного или графического процессора. CPU и GPU не предназначены для работы с ИИ.

Первое поколение

Впервые нейронный процессор появился в Apple A11 Bionic. Предыдущий чип Apple A10 имел приставку Fusion.

Это первое поколение Neural Engine, которое было встроено чип Apple. В него установлено 2 ядра и оно может выполнять до 600 миллиардов операций в секунду.

Сторонние приложения не могут использовать нейронный движок этого поколения, что приводит к аналогичной производительности нейронной сети для старых iPhone.

Второе поколение

Следующее поколение сделало достаточно большой рывок по сравнению с предыдущим.

Вторая версия включает в себя “нейронный движок» следующего поколения, который установлен сразу в трех чипах компании Apple. Это поколение имеет целых 8 ядер и может выполнять до 5 триллионов операций в секунду, что до 9 раз быстрее по сравнению с Apple A11.

В отличие от Neural Engine 1-го поколения, 2-ое поколение предоставляет доступ для сторонних приложений.

Третье поколение

Третье поколение не сильно продвинулось по сравнению со вторым, но улучшения есть.

Следующий процессор Apple A-серии также включает в себя Neural Engine нового поколения. Имеет 8 ядер, как и ранее, которые стали на 20% быстрее и на 15% меньше потребляют энергию, а также работают до 6 раз производительнее.

Apple добавила в 3 – е поколении специальный ускоритель — блоки AMX. Они ориентированы на выполнение ключевых задач машинного обучения.

Четвертое поколение

Это поколение стало первым для Mac. Neural Engine этого поколения стал сильно лучше в задачах с использованием ИИ.

Четвертая версия содержит в себе нейронный процессор более нового поколения. В нем установлено 16 ядер, больше чем ранее в целых два раза. Они выполняют до 11 триллионов операций за 1 секунду, что по утверждениям Apple на 80% быстрее.

В чипах использующих это поколение, как и в A13, установлен специальный ускоритель — блоки AMX. Они ориентированы на выполнение ключевых задач машинного обучения.

Что известно про чип M1 в новых Mac и MacBook: производительность, тесты, факты

В России начались официальные продажи новых MacBook Air, MacBook Pro и Mac mini на базе Apple M1.

Самое время разобраться с этими чипсетами, в основе которых лежит архитектура ARM: неужели они действительно настолько интересные, как про них говорит сама компания.

Вокруг Apple M1 предостаточно вопросов. Важно понять их производительность в разных задачах, как они ведут себя без активного охлаждения, что там с реальной автономностью и работой приложений, которые пока не успели адаптировать под ARM. Со всем этим и разберемся в данном материале.

Какие Mac получили чипсет Apple M1 в числе первых

В рамках WWDC 2020 Apple впервые сообщила про отказ от Intel и переход на чипсеты собственного производства, который должен состояться на протяжении двух лет. Компания также пообещала, что первые компьютеры на базе них должны появиться к концу года: 10 ноября, на очередной презентации, она их показала.

Пионерский чипсет получил название Apple M1. Сегодня он используется во всех новых MacBook Air, базовых двухпортовых MacBook Pro с диагональю 13 дюймов (топовые модели все еще комплектуются чипами Intel), а также в некоторых комплектациях Mac mini. Ожидать других вариантов в 2020 году не стоит.

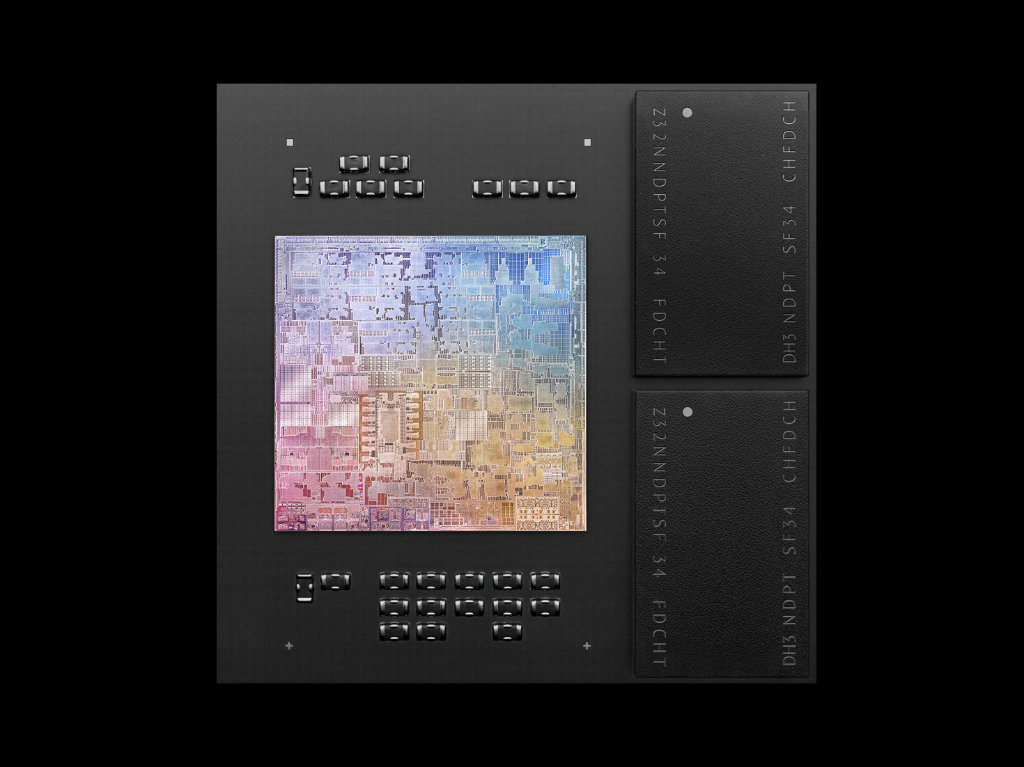

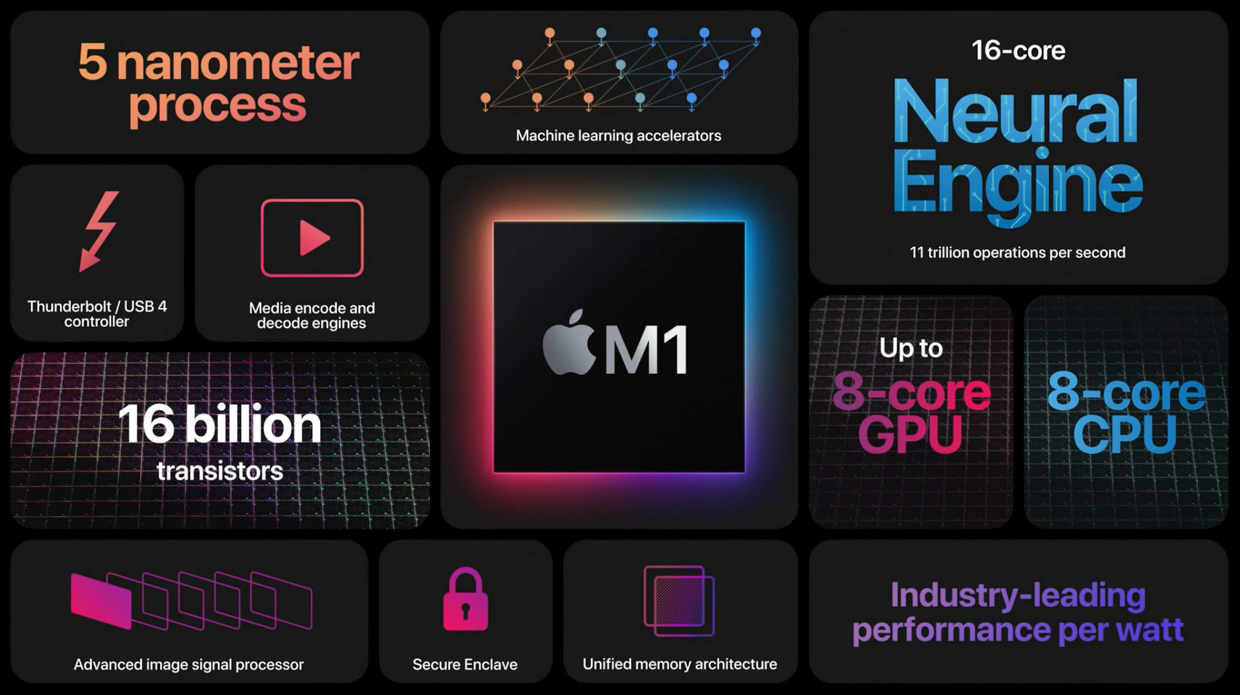

Apple M1 разработан с использованием 5-нанометрового технологического процесса и вмещает 16 миллиардов транзисторов. С одной стороны, у него есть явное родство с чипсетами из семейства Apple A: в их основе лежит архитектура ARM. С другой стороны, он заточен под потребности Mac и macOS 11 Big Sur.

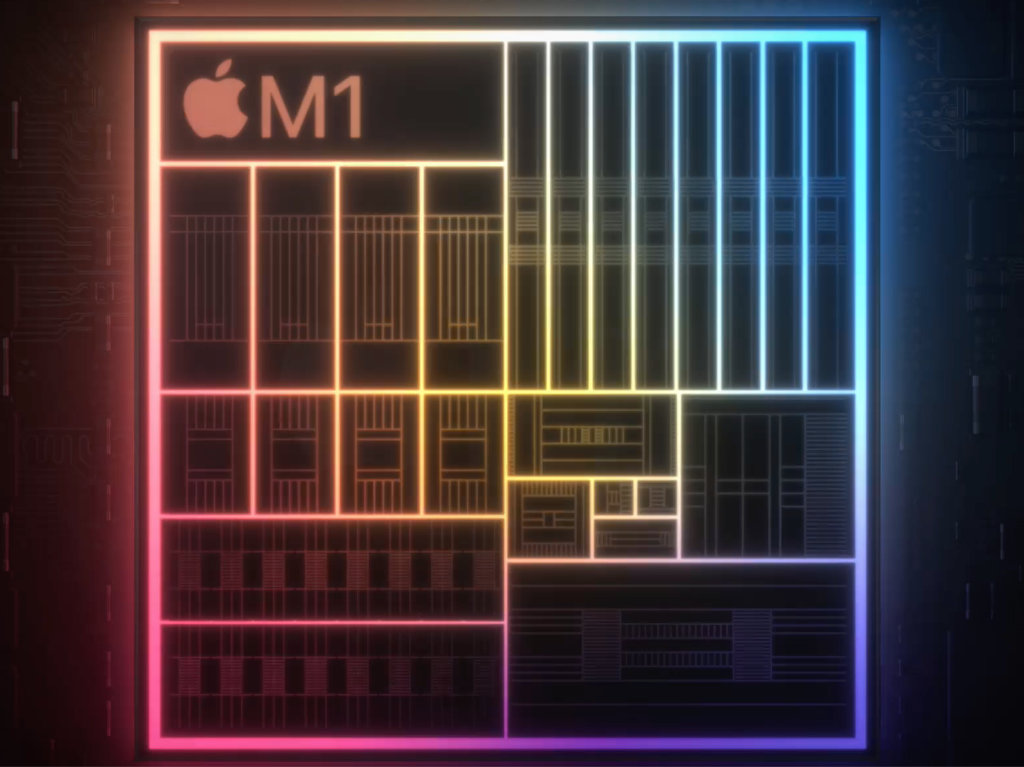

Что кроме центрального процессора входит в Apple M1

Называть Apple M1 процессором нельзя — это система на чипе (SoC), состоящая из нескольких компонентов, которые максимально эффективно взаимодействуют между собой. Она отличается высоким уровнем интеграции, который значительно повышает производительность и энергоэффективность.

Центральный процессор. Он состоит из восьми ядер: первая четверка более производительная и отвечает за сложные задачи, вторая отличается повышенной энергоэффективностью и используется, когда высокая мощность не нужна. Они распределяют нагрузку между собой, в зависимости от задач.

Когда вы используете тяжелый софт (Final Cut для работы с видео или Logic Pro для музыкального продакшна), подключаются производительные ядра. Для работы с офисным контентом, текстовыми записями и прочим достаточно энергоэффективных ядер. Они же нужны, что еще обсудим дальше, для охлаждения.

Графический процессор. Он используется для работы с визуальным контентом самого разного рода. В Apple утверждают, что ничего мощнее на рынке интегрированных решений нет. Да, речь именно про варианты, которые встроены в чипсет: дискретная графика в данном случае в учет не берется.

В компании подчеркивают, что графического процессора, который встроен в чипсет Apple M1, хватит для плавного воспроизведения роликов в 8K, просмотра видео в разрешении 4K в несколько потоков, создания сложных сценариев в Unity и других задач, для которых нужна производительность графики.

Система Neural Engine. Это фирменная система Apple, которая предназначена для работы с нейронными сетями. Она оборудована 16 выделенными ядрами, которые способны обрабатывать до 11 триллионов операций в секунду. В чипсетах из серии Apple A также используется Neural Engine, но менее производительный.

Работа Neural Engine видна во всех приложениях, в которых используется искусственный интеллект. Сама Apple приводит в пример приложение djay Pro Al, которое может разделять музыкальную композиции на отдельные дорожки (вокал, мелодия, бас, ударные) в режиме реального времени.

Оперативная память. Нельзя не отметить и то, что в Apple M1 компания впервые в истории Mac встраивает оперативную память прямо в чипсет. Это нужно для того, чтобы минимизировать задержки при взаимодействии ОЗУ, центрального и графического процесса, а также других систем.

В Apple M1 есть и другие комплектующие, которые предназначены для работы с памятью. Это, в том числе, касается твердотельных накопителей, скорость работы с которыми, благодаря новому чипсету, ощутимо вырастает. В компании говорят, что прирост может составлять до 100%.

Secure Enclave и AES‑модуль. Они предназначены для аппаратного обеспечения безопасности: для корректной работы Touch ID, оплаты через Apple Pay, хранения критически важных для системы данных. Ранее роль Apple M1 в подобном амплуа выполняли отдельные чипы T1 и T2.

Более того, именно на базе Apple M1 теперь работает блокировка активации Mac в удаленном формате, которая становится актуальной при потере или краже компьютера. Пока рано говорить про эффективность данной системы, но она должна ощутимо повыситься именно на новых гаджетах.

Чем чипсеты Apple M1 сегодня отличаются между собой

На первый взгляд, кажется, что в новых MacBook Air, MacBook Pro и Mac mini под управлением Apple M1 используется на 100% одинаковые чипсеты. Тем не менее, важно понимать, что это не так. В отличие от чипов серии Apple A, в данном случае присутствуют дифференциация по паре пунктов.

Информации по поводу реальной разницы в производительности данных решений пока нет. Тем не менее, MacBook Air и не предполагает регулярной интенсивной нагрузки, поэтому для рядовых и периодически сложных задач его все же хватит, а для постоянной работы с графикой лучше смотреть на MacBook Pro.

Оперативная память. Еще раз повторюсь, что сейчас она встроена непосредственно в сам чипсет. Ее может быть либо 8 ГБ, либо 16 ГБ. Второй вариант доступен только в кастомных MacBook Air, MacBook Pro и Mac mini: в российских реалиях за него придется доплатить 20 тыс. руб.

Какие важные вопросы про Apple M1 остаются без ответов

Несмотря на то, что в сети уже появились первые обзоры новых MacBook Air, MacBook Pro и Mac mini, они не отвечают на несколько интересных вопросов, которые могут быть важны для некоторых пользователей. Речь про странные ограничения компьютеров Apple на базе чипов M1.

Только два порта USB-C. В Mac под управлением Apple M1, которые сейчас доступны в продаже, большее количество пока не предусмотрено: в MacBook Air и MacBook Pro кроме 3,5-мм аудиовыхода вообще нет других интерфейсов для подключения, а в Mac mini доступны менее скоростные.

Не больше 16 ГБ ОЗУ и 2 TБ SSD. Базовые модели MacBook Air, MacBook Pro и Mac mini поставляются с SSD на 256 ГБ. Кастомные получится «разогнать» лишь до 2 ТБ: 4 ТБ пока добиться не получится. Это или ограничение контроллера памяти Apple M1, или вопрос позиционирования.

Это же касается и оперативной памяти, которая встроена в чипсет. Ее может быть или 8 ГБ, или 16 ГБ — более емкие варианты не предусмотрены. В Pro на 13 дюймов хотелось бы видеть и 32 ГБ, но, быть может, в более производительных моделях в будущем такой вариант также будет доступен.

Подключение одного монитора. К MacBook Air и MacBook Pro через USB-C получится подключить по одному монитору с разрешением до 6K: пару по 4K и меньше почему-то нельзя. Mac mini также поддерживает подключение еще одного дисплея через HDMI, но у портов USB-С такое же ограничение.

Какое охлаждение нужно для M1: активное или пассивное

Компьютеры Apple на базе чипов M1 предполагают два вида охлаждения: активное с использованием вентиляторов и пассивное без подвижных элементов. Первое касается MacBook Pro и Mac mini, второе — MacBook Air. К чему такое разделение, если в последнем может быть настолько же мощный чип, как в первых?

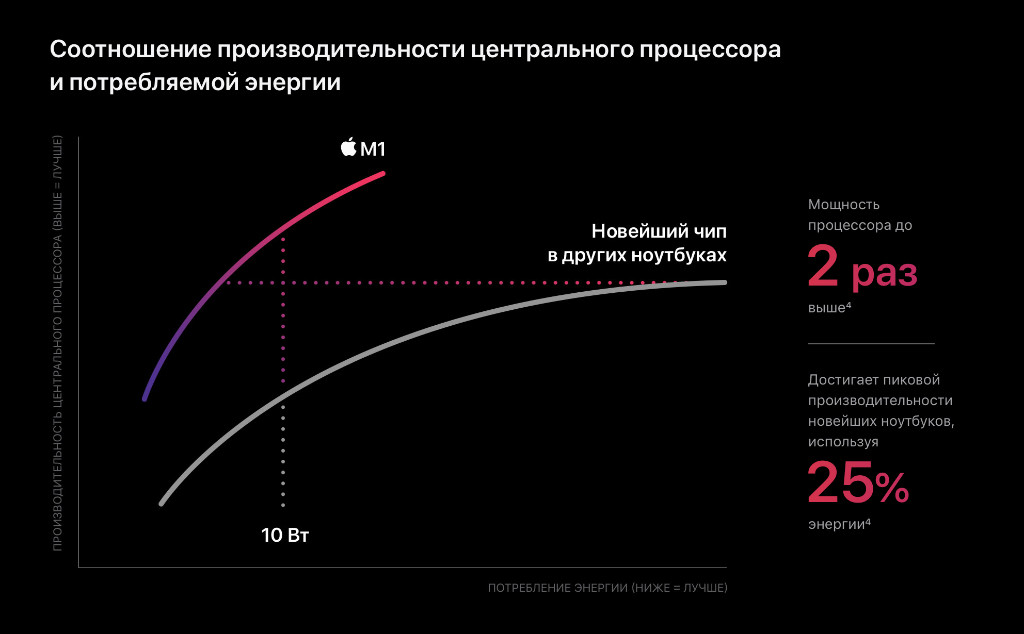

Первые обзоры новых компьютеров Apple показали, что чипы M1 с одинаковой конфигурацией работают одинаково хорошо на любом компьютере. Вопрос охлаждения встает только при длительной интенсивной нагрузке: когда чип подвергается долгим синтетическим тестам или занимается рендером графики.

У M1 специфическая система троттлинга. В отличие от решений Intel, ядра, которые входят в его комплект, всегда работают на максимальной для себя частоте. Чтобы понизить свою температуру, чипсет переводит нагрузку с производительных ядер на эффективные : так скорость работы падает вместе с градусами.

В MacBook Air нет активного охлаждения, поэтому с подобным процессом при большой долговременной нагрузке получится сталкиваться чаще, чем на MacBook Pro и на Mac mini. Поэтому первый больше подходит для обычного использования, а пара последних заточена и под напряженное.

Какое время автономной работы у первых ноутбуков на M1

MacBook Air комплектуется аккумулятором на 49,9 Вт∙ч, MacBook Pro — на 58,2 Вт∙ч. По заверениям Apple, первый вместе с M1 должен проработать до 15 часов при интернет-серфинге и до 18 часов при воспроизведении фильмов из сервиса Apple TV. Второй: 17 и 20 часов соответсвенно.

По первым обзорам ноутбуков, на которые есть ссылке в начале тексте, реальное время автономной работы находится на уровне от 8 до 10 часов. Да, оно меньше, но вполне соответсвует 50% увеличению в случае MacBook Air и до 100% в ситуации с MacBook Pro, о чем шла речь на презентации Apple.

Результат на уровне 8–10 часов кажется действительно удивительным. Он начинает становится еще более фантастическим, если учитывать возможность зарядки с помощью мощных внешних аккумуляторов с поддержкой Power Delivery. «Банки» средней руки легко добавят к автономности 100% и даже 150%.

Что с реальной производительностью чипсета Apple M1

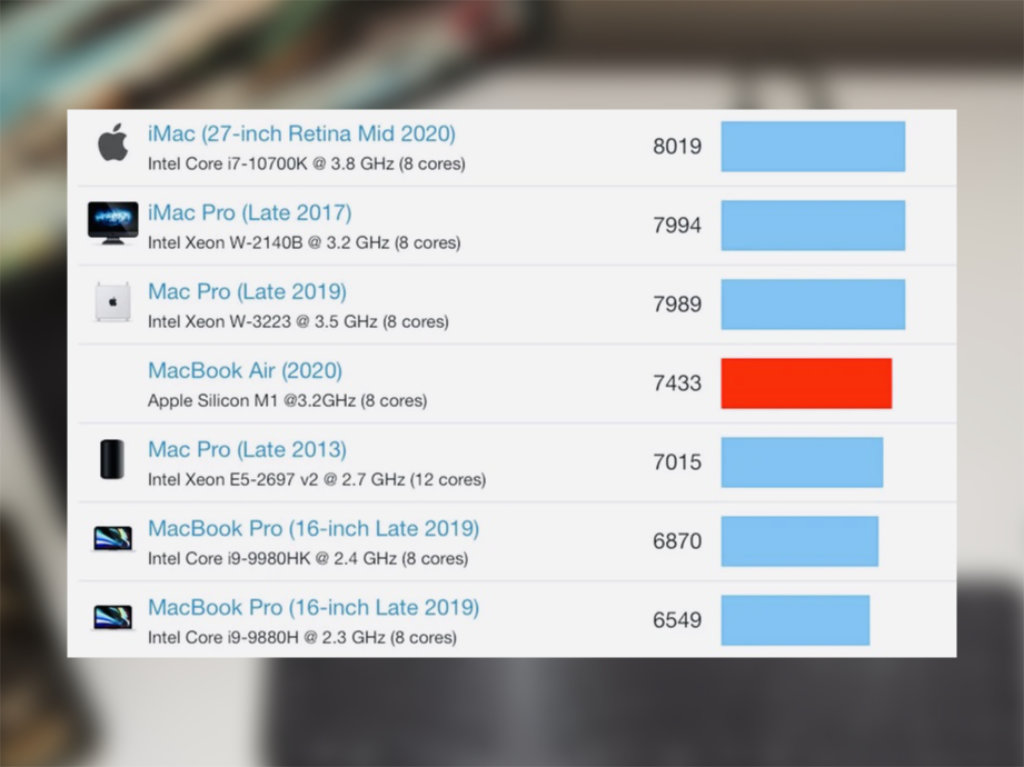

В Geekbench центральный процессор MacBook Air на базе M1 набирает почти 1700 баллов в одноядерном тесте и обгоняет абсолютно все компьютеры, которые компания Apple когда-либо выпускала. В многоядерном тесте он набирает более 7400 баллов и вплотную приближается к Mac Pro 2019 года на базе Intel Xeon.

В синтетическом тесте GFXBench графический процессор Apple M1 обогнал видеокарты Nvidia GeForce GTX 1050 Ti и AMD Radeon RX 560. В компании не обманывали по поводу того, что это — самая производительная интегрированная графика. На средних настройках получится и пару каток в Dota 2 сообразить.

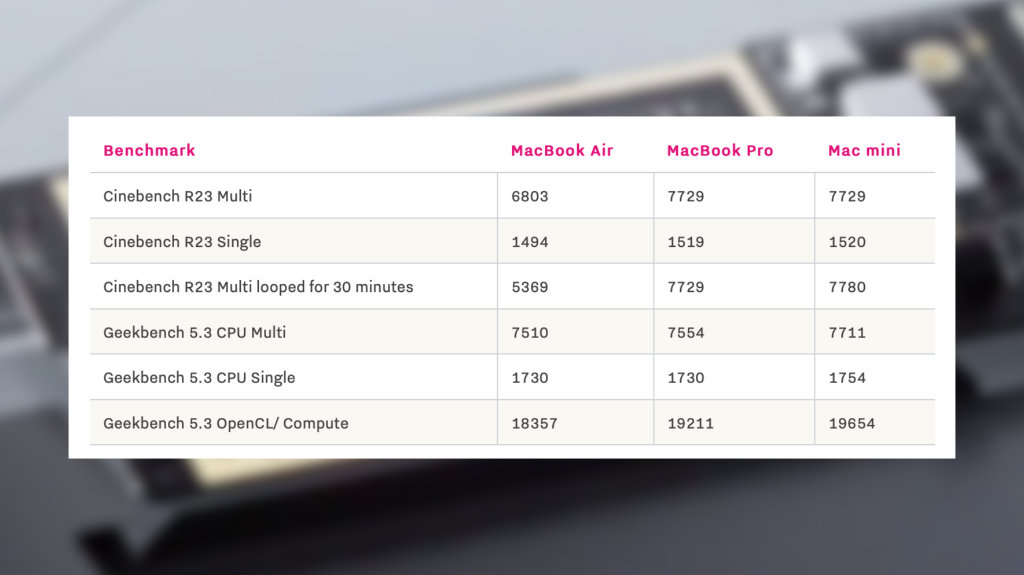

По графическому тесту Cinebench, результаты которого также представлены выше, становится понятно, что при серьезной длительной нагрузке MacBook Air начинает отставать от MacBook Pro и Mac mini. Как уже отмечалось выше по тексту, это связано с использованием пассивного охлаждения.

Как на базе чипа Apple M1 работают разные приложения

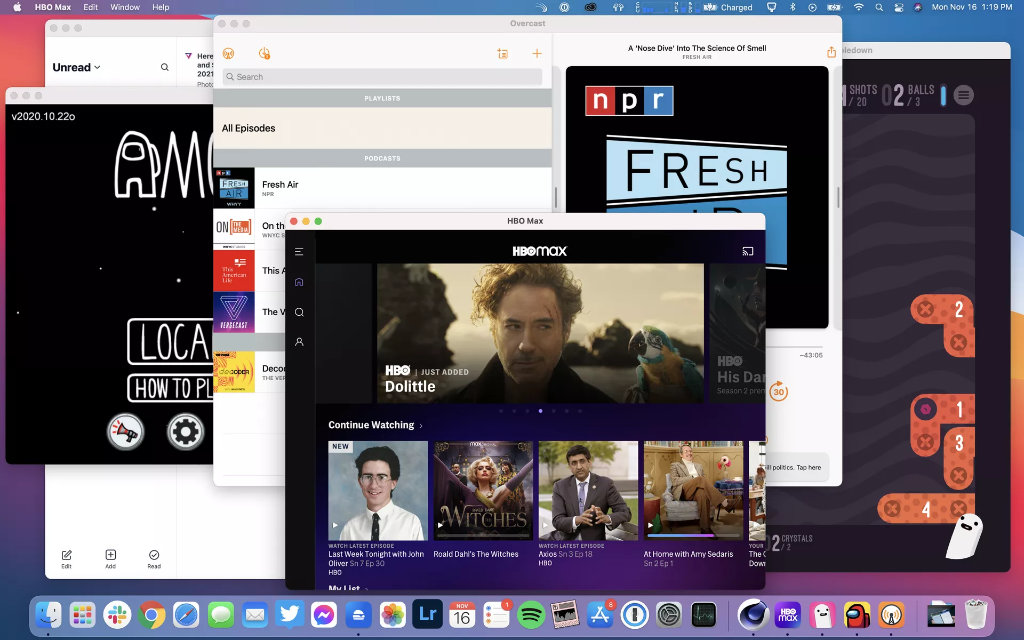

Для начала нужно отметить, что на компьютерах под управлением Apple M1 нужно говорить сразу про три типа приложений. Во-первых, есть программы, которые адаптированы под новую архитектуру. Во-вторых, важно отметить эмуляцию приложений неподдерживаемых через Rosetta 2. В-третьих, софт для iOS и iPadOS.

Конечно, лучше всего Apple M1 работает с приложениями, которые под него адаптированы. В числе первых поддержку данного чипсета получил графический редактор Affinity Photo, который сам я достаточно давно использую в качестве альтернативы для Adobe Photoshop. Apple показала его на презентации.

Даже с учетом падения производительности на уровне 25–30% из-за Rosetta 2 приложения также работают без нареканий. Это, в том числе, касается того же Adobe Photoshop, который обещают адаптировать только в первом квартале 2021 года. Он должен показывать большую скорость, чем на предшественниках.

Подводя итоги: краткое резюме про чипсет Apple M1

Во-первых, учитывайте дифференциацию Apple M1, которая сильно отличает их от линейки Apple A. В Mac на базе фирменных чипсетов может использоваться разный объем оперативной памяти, а также разное количество графических ядер. Внимания заслуживает и тип охлаждения: активное, безусловно, лучше.

Во-вторых, важно трезво оценивать актуальные ограничения Apple M1. На данный момент времени чипсеты не поддерживают больше 16 ГБ оперативной памяти и больше 2 ТБ постоянной. Они не работают с парой мониторов через USB-C, да и этих портов в них пока не бывает больше двух штук.

В-третьих, время реальной автономной работы ноутбуков не может не радовать: 8–10 часов при полноценном использовании. Оно должно еще увеличиться, когда большинство приложений будут использовать Apple M1 нативно, а не через эмуляцию средствами Rosetta 2.

В-четвертых, Mac на базе Apple M1 можно брать уже сегодня. Они отлично работают даже с не адаптированными приложениями, и падение производительности с ними на уровне 25–30% можно пережить. Если говорить про адаптированные, чип показывает мощность на уровне Mac Pro 2019 года. Поразительно.

В-пятых, рассчитывать на полноценную поддержку мобильных приложений не стоит. У разработчиков есть возможность ограничить их установку на Mac. Заточенные под сенсорное управление программы все равно не будут работать на 100% корректно без его использования.